Google AI 安全框架 SAIF详解:六大核心要素与风险地图一览

2025-04-21

来源:

01

SAIF的六大核心要素

继承互联网时代的安全防护经验,将默认安全(Secure-by-default)机制延伸至AI基础设施 建立专业化AI安全团队,持续跟踪技术演进并优化防护体系 针对新型攻击模式(如提示注入攻击)优化防御策略,采用输入净化、权限限制等成熟防护手段

建立AI系统输入输出监控机制,实时检测异常行为 整合威胁情报系统,构建预测性防御能力 建立跨部门协同机制,联动信任安全、威胁情报和反滥用团队

运用AI技术提升安全事件响应效率与规模 构建动态防御能力,通过对抗性训练提升系统韧性 采用成本效益优化的防护策略,应对AI赋能的规模化攻击

实施跨平台安全控制框架,确保防护策略一致性 将安全防护深度集成至AI开发全流程(如Vertex AI平台) 通过API级防护(如Perspective API)实现规模化安全赋能

建立持续学习机制,基于事件反馈优化防护模型 实施战略级防御调优:更新训练数据集、构建行为异常检测模型 定期开展红队演练,完善AI产品安全验证体系

实施端到端风险评估,涵盖数据溯源、验证机制等关键环节 构建自动化检测体系,持续监控AI系统运行状态 建立业务场景化风险评估模型,实现精准风险管控

02

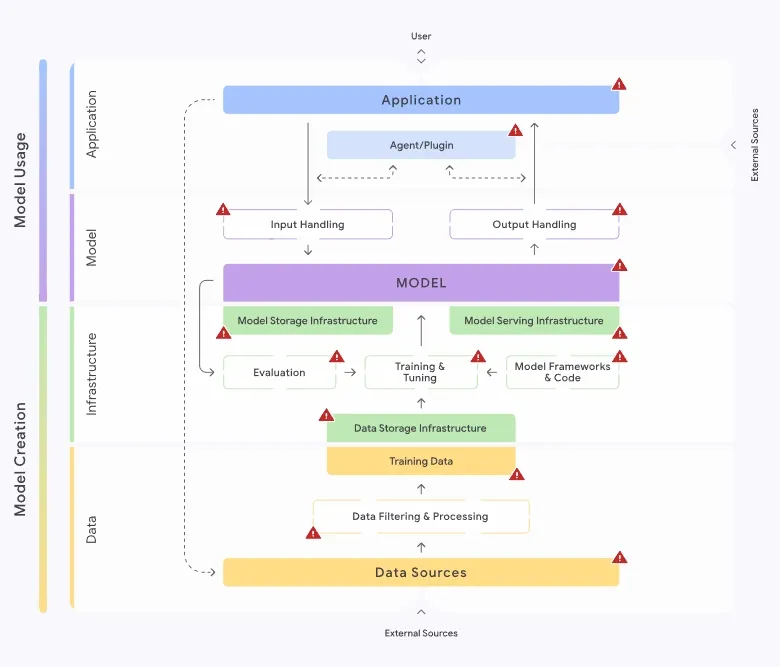

SAIF风险地图框架解析

数据来源:数据库、API、网络爬取等原始数据采集渠道,影响模型能力基线。 数据处理:清洗、标注、合成等预处理流程,决定训练数据质量。 训练数据:最终用于模型训练的精选数据集,直接塑造模型参数(权重)。

模型框架与代码:定义模型架构(如层数、算法)的基础代码,需防范篡改导致的模型行为异常。 训练调优评估:通过调整概率参数(训练 / 调优)和新数据测试(评估)优化模型,预训练模型微调是常见实践。 数据模型存储:涵盖训练过程临时存储、模型库发布存储,远程 API 调用场景需关注存储安全复用问题。 模型服务:生产环境部署系统,直接影响模型对外提供推理服务的安全性(如 API 调用风险)。

模型本体:代码与权重的结合体,AI 开发的核心产物,依赖数据与基础设施组件构建。 输入处理:过滤恶意输入(如提示注入攻击),是防范外部风险的第一道防线。 输出处理:管控有害或意外输出,需持续优化过滤机制(当前重点研发领域)。

应用层:直接面向用户(如客服机器人)或内部服务的功能载体,具备工具执行能力时称为 “代理”。 代理 / 插件:调用外部服务完成特定任务的模块,每次调用可能引入链式风险(如第三方数据接口漏洞)。

03

SAIF地图风险详解及缓解措施

这部分内容总结了SAIF地图中的每个风险,包括核心风险、攻击场景以及缓解措施。

下一篇:这是最后一篇

上一篇:这是第一篇

写评论...